Расшифровка у7: Сталь У7, У7А – расшифровка марки стали, ГОСТ, характеристика материала

alexxlab | 06.09.2020 | 0 | Разное

Марка стали У7, У7А: Расшифровка и характеристики, ГОСТ

- Главная

- Справочник

- Марки сталей

- У7, У7А

|

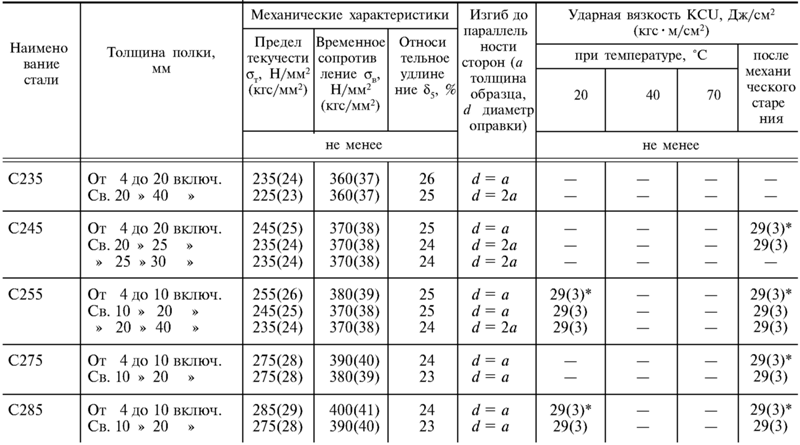

Марка стали |

Вид поставки Прутки, полосы и мотки – ГОСТ 1435–99. |

||||||||||||||||||||||||||||||

|

У7, У7А |

|||||||||||||||||||||||||||||||

|

Массовая доля элементов, % по ГОСТ 1435–99 |

Марка стали |

Температура критических точек, ºС |

|||||||||||||||||||||||||||||

|

C |

Si |

Mn |

S |

P |

Cr1 |

Ni1 |

Mo |

Cu1 |

Ас1 |

Ас3 |

Аr1 |

Аr3 |

Мн2 |

Мк |

|||||||||||||||||

|

0,65–0,74 |

0,17–0,33 |

0,17–0,33 |

≤ 0,028 |

≤ 0,030 |

0,12– 0,40 |

0,12–0,25 |

– |

0,20–0,25 |

У7 |

730 |

770 |

700 |

– |

280 |

– |

||||||||||||||||

|

0,17–0,28 |

≤ 0,018 |

≤ 0,025 |

У7А |

||||||||||||||||||||||||||||

|

1 Массовая доля Cr, Ni, Cu в зависимости от группы металлопродукции. |

2 Нагрев до 950 ºС. |

||||||||||||||||||||||||||||||

|

Механические свойства при комнатной температуре |

|||||||||||||||||||||||||||||||

|

НД |

Режим термообработки |

Сечение, мм |

σ0,2, Н/мм2 |

σВ, Н/мм2 |

δ, % |

Ψ, % |

KCU, Дж/см2 |

HRC |

НВ |

||||||||||||||||||||||

|

Операция |

t, ºС |

Охлаждающая среда |

не менее |

||||||||||||||||||||||||||||

|

ГОСТ 1435–99 |

Отжиг |

690–710 |

С печью (скорость 50 ºС/ч) |

Не определяются |

– |

≤ 187 |

|||||||||||||||||||||||||

|

Закалка |

800–820 |

Вода |

≥ 62 |

||||||||||||||||||||||||||||

|

Термически обработан- ная металло-продукция |

≤ 5 |

– |

650 |

– |

– |

– |

– |

– |

|||||||||||||||||||||||

|

ГОСТ 2283–79 |

Отожженная лента повы- шенного ка- чества (ОП) |

Свыше 1,50 |

– |

640 |

10 |

– |

– |

– |

– |

||||||||||||||||||||||

|

Отожженная лента обык- новенного качества |

До 1,50 Свыше 1,50 |

– – |

640 740 |

15 10 |

– – |

– – |

– – |

– – |

|||||||||||||||||||||||

|

Лента нагар- тованная обыкновен-ного качества |

До 1,50 Свыше 1,50 |

– – |

740– 1180 740– 1180 |

– – |

– – |

– – |

– – |

– – |

|||||||||||||||||||||||

|

У7, У7А |

Механические свойства при комнатной температуре |

||||||||||||||||||||||||||||||||||||

|

НД |

Режим термообработки |

Сечение, мм |

σ0,2, Н/мм2 |

σВ, Н/мм2 |

δ, % |

Ψ, % |

KCU, Дж/см2 |

HRC |

НВ |

||||||||||||||||||||||||||||

|

Операция |

t, ºС |

Охлаждающая среда |

не менее |

||||||||||||||||||||||||||||||||||

|

ГОСТ 10234–77 |

Отожженная лента 1ой категории качества |

0,10– 4,00 |

– |

780 |

10 |

– |

– |

– |

– |

||||||||||||||||||||||||||||

|

Нагартован-ная лента 1ой категории качества |

0,10– 4,00 |

– |

780– 1270 |

– |

– |

– |

– |

– |

|||||||||||||||||||||||||||||

|

Отожженная лента высшей категории качества |

0,10– 4,00 |

– |

570 |

– |

– |

– |

– |

– |

|||||||||||||||||||||||||||||

|

Нагартован-ная лента высшей кате-гории ка-чества |

0,10– 4,00 |

– |

780– 930 930– 1080 1080–1230 |

Г13 Г23 Г33 |

– – – |

– – – |

– – – |

– – – |

|||||||||||||||||||||||||||||

|

3 Класс прочности. |

|||||||||||||||||||||||||||||||||||||

|

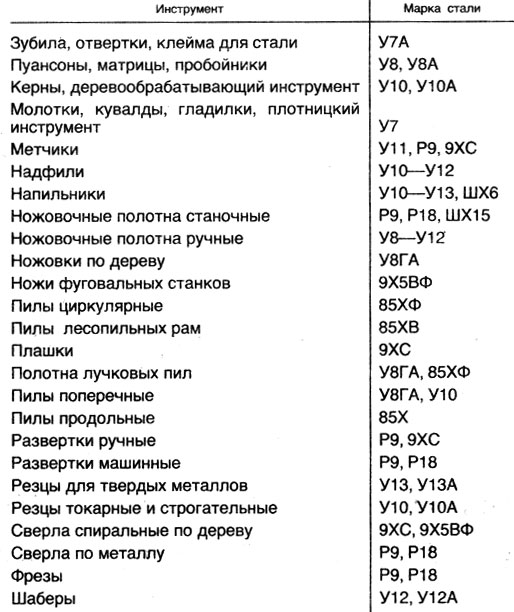

Назначение. Инструмент для обработки дерева: топоры, колуны, стамески, долота; пневматический инструмент небольших размеров: зубила, обжимки, бойки; кузнечные штампы; игольная проволока; слесарно-монтажный инструмент: молотки, кувалды, бородки, отвертки, комбинированные плоскогубцы, боковые кусачки, рашпили, зубила, крейцмесели, пружины, измерительные ленты и др. |

|||||||||||||||||||||||||||||||||||||

|

Предел выносливости, Н/мм2 |

Термообработка |

Ударная вязкость, KCU, Дж/см2, при t, ºС |

Термообработка |

||||||||||||||||||||||||||||||||||

|

σ-1 |

τ-1 |

+ 20 |

0 |

– 20 |

– 40 |

– 60 |

– 80 |

||||||||||||||||||||||||||||||

|

630 |

350 |

σВ = 1270 Н/мм2 |

|||||||||||||||||||||||||||||||||||

|

Теплостойкость |

Шлифуемость |

Критический диаметр, мм, при закалке |

|||||||||||||||||||||||||||||||||||

|

В воде |

В масле |

В селитре |

На воздухе |

||||||||||||||||||||||||||||||||||

|

62 HRC, 150–160 ºС, 1 ч 58 HRC, 200–220 ºС, 1 ч |

Хорошая |

15–20 |

4–6 |

4–6 |

Не закаливается |

||||||||||||||||||||||||||||||||

|

Технологические характеристики |

|||||||||||||||||||||||||||||||||||||

|

Ковка |

Охлаждение поковок, изготовленных |

||||||||||||||||||||||||||||||||||||

|

Вид полуфабриката |

Температурный интервал ковки, ºС |

из слитков |

из заготовок |

||||||||||||||||||||||||||||||||||

|

Размер сечения, мм |

Условия охлаждения |

Размер сечения, мм |

Условия охлаждения |

||||||||||||||||||||||||||||||||||

|

Слиток |

1150–800 |

До 100 101–700 |

В штабелях на воздухе Отжиг с перекристаллизацией, одно переохлаждение |

До 100 101–300 |

На воздухе В яме |

||||||||||||||||||||||||||||||||

|

Заготовка |

1180–800 |

||||||||||||||||||||||||||||||||||||

|

Свариваемость |

Обрабатываемость резанием |

Флокеночувствительность |

|||||||||||||||||||||||||||||||||||

|

Не применяется для сварных конструкций |

В отожженном состоянии при 187 НВ, σВ = 630 Н/мм2 К√ = 1,2 (твердый сплав), К√ = 1,1 (быстрорежущая сталь) |

Не чувствительна |

|||||||||||||||||||||||||||||||||||

|

Склонность к отпускной хрупкости |

|||||||||||||||||||||||||||||||||||||

|

Не склонна |

|||||||||||||||||||||||||||||||||||||

Другие стали углеродистые и легированные

Оставьте заявку и получитеактуальные цены и сроки поставки Ответим в течение 15 минут.

Предложение будет у вас в течение 24 часов

Предложение будет у вас в течение 24 часовОтправляя форму, я соглашаюсь с политикой о персональных данных

Сталь У7 | У7 расшифровка стали | Марка стали У7 | Марки У7 | У7 | У7 характеристики | У7 расшифровка | Сталь У7 характеристики | У7 гост | Сталь У7 У8 | У7 применение | У7 какая сталь | Сталь У7 применение | Расшифровать У7

Марка : | У7, У7А |

Заменитель: | У8 |

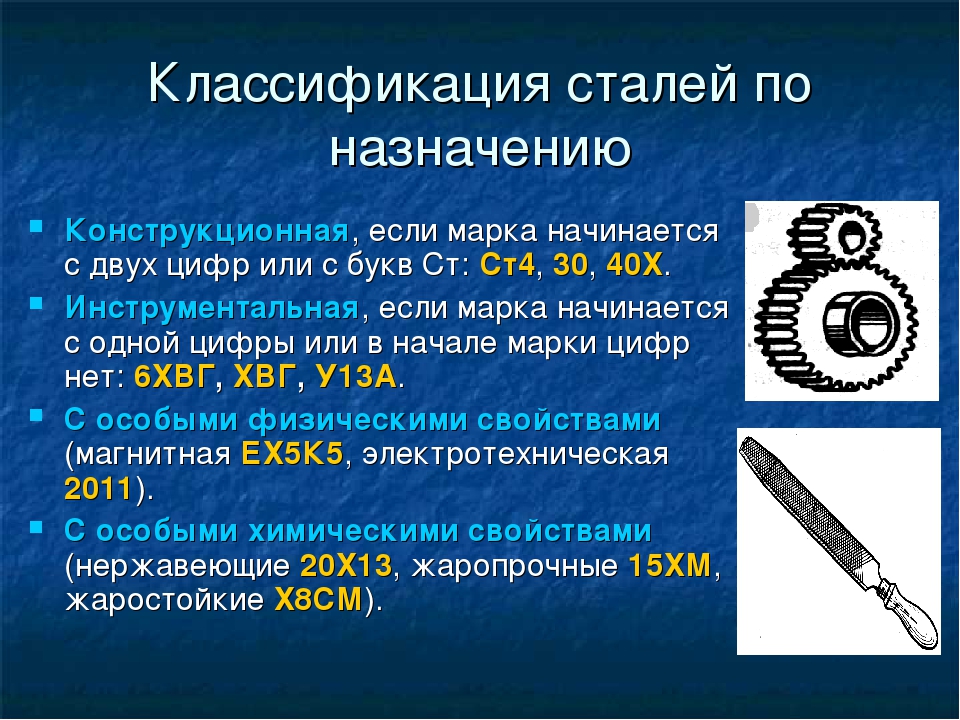

Классификация : | Сталь инструментальная углеродистая |

Применение: | инструмент, который работает в условиях, не вызывающих разогрева рабочей кромки: зубила, долота, бородки, молотки, лезвия ножниц для резки металла, топоры, колуны, стамески, плоскогубцы комбинированные, кувалды. |

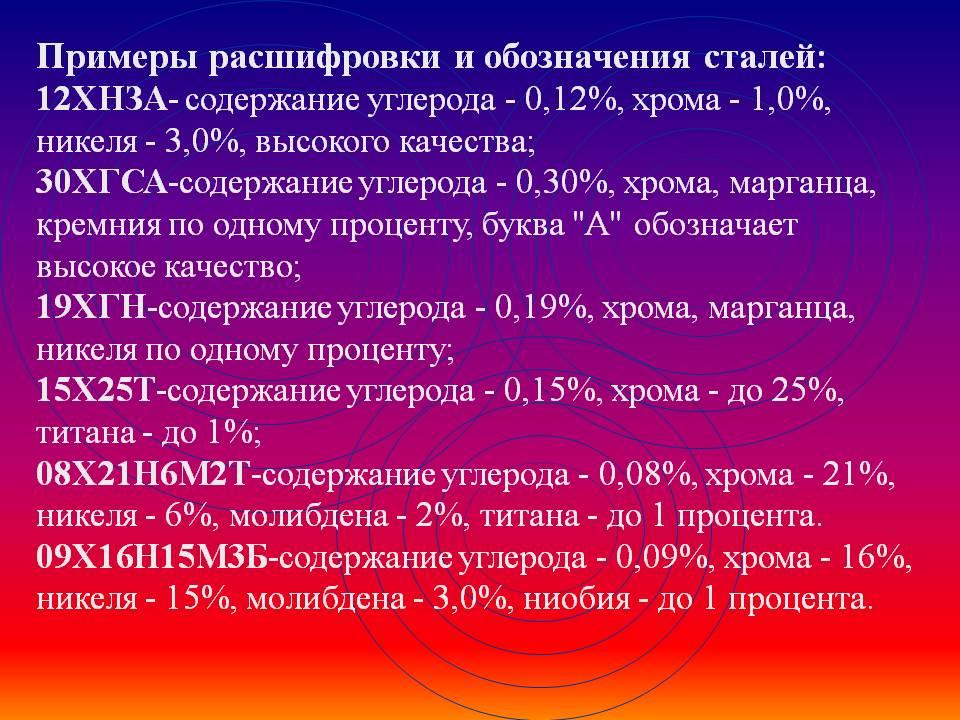

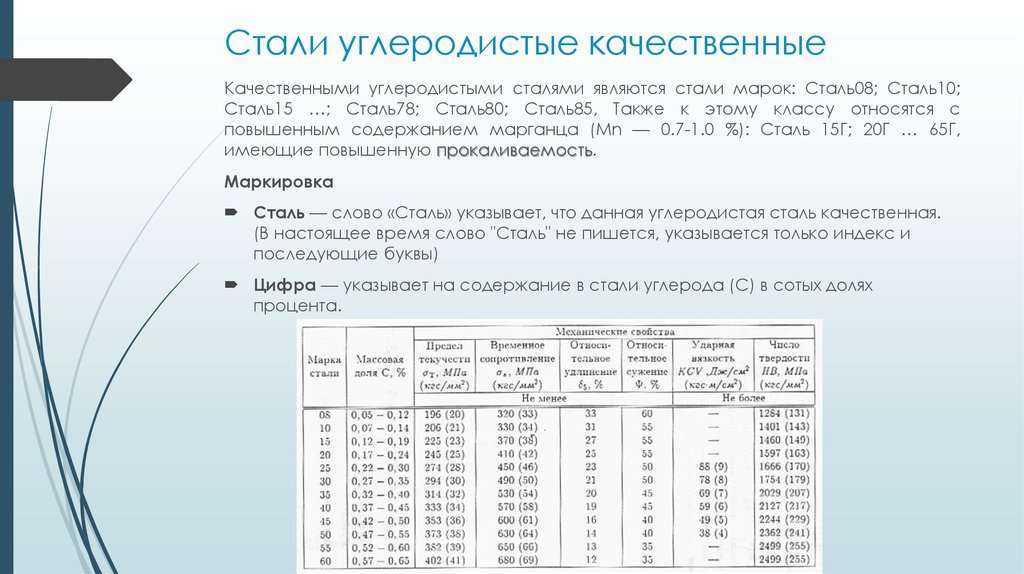

Химический состав в % материала У7

ГОСТ 1435 ― 99

C | Si | Mn | Ni | S | P | Cr | Cu |

0.65 ― 0.74 | 0.17 ― 0.33 | 0.17 ― 0.33 | до 0.25 | до 0.028 | до 0.03 | до 0. | до 0.25 |

Температура критических точек материала У7.

Ac1 = 730 , Ac3(Acm) = 770 , Ar1 = 700 , Mn = 280 |

Технологические свойства материала У7 .

Свариваемость: | не применяется для сварных конструкций. |

Флокеночувствительность: | не чувствительна. |

Склонность к отпускной хрупкости: | не склонна. |

Механические свойства при Т=20oС материала У7 .

Сортамент | Размер | Напр. | sв | sT | d5 | y | KCU | Термообр. |

– | мм | – | МПа | МПа | % | % | кДж / м2 | – |

Лента холоднокатан. | до 1 |

| 650 |

| 15 |

|

| Состояние поставки |

Твердость У7 после отжига , ГОСТ 1435-99 | HB 10 -1 = 187 МПа |

Физические свойства материала У7 .

T | E 10– 5 | a 10 6 | l | r | C | R 10 9 |

Град | МПа | 1/Град | Вт/(м·град) | кг/м3 | Дж/(кг·град) | Ом·м |

20 |

|

| 46 | 7830 |

| 130 |

100 |

|

| 46 |

|

|

|

200 |

|

|

|

|

|

|

300 |

|

| 41 |

| 580 |

|

400 |

|

|

|

| 664 |

|

500 |

|

|

|

| 819 |

|

600 |

|

| 33 |

| 970 |

|

700 |

|

|

|

| 710 |

|

800 |

|

|

|

| 706 |

|

900 |

|

| 29 |

| 685 |

|

T | E 10– 5 | a 10 6 | l | r | C | R 10 9 |

Зарубежные аналоги материала У7

Внимание! Указаны как точные, так и ближайшие аналоги.

Германия | Япония | Франция | Евросоюз | Италия | Китай | Болгария | Венгрия | Польша | Румыния | Чехия | Австрия | |||||||||||||

DIN,WNr | JIS | AFNOR | EN | UNI | GB | BDS | MSZ | PN | STAS | CSN | ONORM | |||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

Обозначения:

Механические свойства : | |

sв | – Предел кратковременной прочности , [МПа] |

sT | – Предел пропорциональности (предел текучести для остаточной деформации), [МПа] |

d5 | – Относительное удлинение при разрыве , [ % ] |

y | – Относительное сужение , [ % ] |

KCU | – Ударная вязкость , [ кДж / м2] |

HB | – Твердость по Бринеллю , [МПа] |

| |

T | – Температура, при которой получены данные свойства , [Град] |

E | – Модуль упругости первого рода , [МПа] |

a | – Коэффициент температурного (линейного) расширения (диапазон 20o ― T ) , [1/Град] |

l | – Коэффициент теплопроводности (теплоемкость материала) , [Вт/(м·град)] |

r | – Плотность материала , [кг/м3] |

C | – Удельная теплоемкость материала (диапазон 20o ― T ), [Дж/(кг·град)] |

R | – Удельное электросопротивление, [Ом·м] |

| |

без ограничений | – сварка производится без подогрева и без последующей термообработки |

ограниченно свариваемая | – сварка возможна при подогреве до 100-120 град. |

трудносвариваемая | – для получения качественных сварных соединений требуются дополнительные операции: подогрев до 200-300 град. при сварке, термообработка после сварки ― отжиг |

Код Хэмминга (7,4) с мягким и жестким декодированием

Ранее мы обсуждали декодирование с жестким решением для кода Хэмминга (7,4) и моделировали частоту ошибок по битам. В этом посте давайте сосредоточимся на декодировании мягкого решения для кода Хэмминга (7,4) и количественно оценим границы прироста производительности.

Коды Хэмминга (7,4)

В коде Хэмминга у нас есть 4 информационных бита, и нам нужно добавить 3 бита четности, чтобы сформировать 7 закодированных битов.

Операция кодирования может быть обозначена в матричной алгебре следующим образом:

где

– последовательность сообщений измерения ,

– матрица кодирования измерения ,

– кодированная последовательность измерения .

Используя пример, приведенный в восьмой главе (пример 8.1-1) «Цифровые коммуникации» Джона Проакиса, пусть матрица кодирования будет

.

Эту матрицу можно рассматривать как

,

, где

— это единичная матрица, а

— это матрица проверки на четность.

Так как матрица идентичности, первые закодированные биты идентичны битам исходного сообщения, а оставшиеся биты образуют матрицу проверки на четность.

Кодовая матрица такого типа, в которой необработанные биты сообщения отправляются как есть, называется систематическим кодом .

Если предположить, что последовательность сообщений , то закодированная последовательность вывода будет следующей:

, где

,

,

.

Оператор обозначает оператор исключающего ИЛИ (XOR).

Матрица допустимой кодированной последовательности размерности

| м0 | м1 | м2 | м3 | р0 | стр. 1 1 | стр.2 | |

| 0 | 0 | 0 | 0 | 0 | 0 | 0 | 0 |

| 1 | 0 | 0 | 0 | 1 | 0 | 1 | 1 |

| 2 | 0 | 0 | 1 | 0 | 1 | 1 | 0 |

| 3 | 0 | 0 | 1 | 1 | 1 | 0 | 1 |

| 4 | 0 | 1 | 0 | 0 | 1 | 1 | 1 |

| 5 | 0 | 1 | 0 | 1 | 1 | 0 | 0 |

| 6 | 0 | 1 | 1 | 0 | 0 | 0 | 1 |

| 7 | 0 | 1 | 1 | 1 | 0 | 1 | 0 |

| 8 | 1 | 0 | 0 | 0 | 1 | 0 | 1 |

| 9 | 1 | 0 | 0 | 1 | 1 | 1 | 0 |

| 10 | 1 | 0 | 1 | 0 | 0 | 1 | 1 |

| 11 | 1 | 0 | 1 | 1 | 0 | 0 | 0 |

| 12 | 1 | 1 | 0 | 0 | 0 | 1 | 0 |

| 13 | 1 | 1 | 0 | 1 | 0 | 0 | 1 |

| 14 | 1 | 1 | 1 | 0 | 1 | 0 | 0 |

| 15 | 1 | 1 | 1 | 1 | 1 | 1 | 1 |

Таблица: Кодированная выходная последовательность для всех возможных входных последовательностей

Минимальное расстояние

Расстояние Хэмминга вычисляет количество различных позиций при сравнении двух кодовых слов. Для закодированной выходной последовательности, указанной в таблице выше, мы видим, что минимальное расстояние между парой кодовых слов равно 3.

Для закодированной выходной последовательности, указанной в таблице выше, мы видим, что минимальное расстояние между парой кодовых слов равно 3.

Если возникает ошибка веса, можно преобразовать одно кодовое слово в другое допустимое кодовое слово и ошибка не может быть обнаружена. Таким образом, количество ошибок, которые могут быть обнаружены, равно .

Чтобы определить возможность исправления ошибок, давайте представим, что у нас могут быть допустимые кодовые слова из возможных значений. Если представить каждое кодовое слово в виде сферы радиуса , то наибольшее значение , которое не приводит к перекрытию между сферами, равно

, где

– наибольшее целое число в .

Любое кодовое слово, находящееся в сфере, декодируется в действительное кодовое слово в центре сферы.

Таким образом, возможность исправления ошибок кода с расстоянием равна .

В нашем примере, как , мы можем исправить до 1 ошибку .

Декодирование мягкого решения

Пусть полученное кодовое слово будет,

, где

и

– кодовое слово передачи,

— это аддитивный белый гауссовский шум со средним значением и дисперсией, а

— элементы кодового слова.

При наличии известных кодовых слов цель состоит в том, чтобы найти корреляцию полученного вектора с каждым из допустимых кодовых слов.

Вектор корреляции:

, где

– полученная кодовая последовательность размерности,

– матрица последовательности допустимых кодовых слов размерности, а

– вектор значения корреляции для каждого допустимого кодового слова и имеет размерность

.

Из значений корреляции индекс местоположения, где максимально соответствует кодовому слову передачи с максимальной вероятностью.

Примечание:

Термину присваиваются веса кодовых слов, т. е. 0 присваивается вес -1, 1 присваивается вес 1.

Декодирование жестких решений

Декодирование жесткого решения выполняется с использованием матрицы проверки на четность.

Пусть модель системы будет,

, где

– полученное кодовое слово измерения,

– необработанные биты сообщения измерения,

– необработанные биты сообщения,

– местоположения ошибок измерения.

Умножение принятого кодового слова на матрицу проверки четности,

.

Термин называется синдромом шаблона ошибки и имеет размерность . Термин “синдром” зависит только от последовательности ошибок.

Если предположить, что ошибка касается только одного бита,

а) Возможные места возникновения ошибок.

б) Если синдром равен 0, то это означает, что ошибок нет.

c) Значение синдрома принимает одно из допустимых 7 ненулевых значений. По значению синдрома мы можем определить, какой бит в закодированной последовательности ошибочен, и исправить его .

Примечание:

а) Если у нас есть более одного местоположения ошибки, то синдром также попадет в одну из 8 допустимых последовательностей синдромов и, следовательно, не может быть исправлен.

b) Выбранная матрица кодирования Хэмминга (7,4), двойной код –

.

Можно видеть, что умножение по модулю 2 матрицы кодирования с транспонированием матрицы двойного кода равно нулю, т. е.

.

Выигрыш асимптотического кодирования

Из главы 12.2.1 и главы 12.2.1 книги “Цифровая связь: третье издание” Джона Р. Барри, Эдварда А. Ли, Дэвида Г. Мессершмитта, выигрыш асимптотического кодирования с декодированием с мягким решением и жестким расшифровка решения дается как,

.

где

— скорость кодирования,

— минимальное расстояние между кодовыми словами и

— максимальное количество ошибок, которые можно исправить.

Имитационная модель

Сценарий Matlab/Octave выполняет следующее

(a) Генерирует случайную двоичную последовательность нулей и единиц.

(b) Сгруппируйте их в четыре бита, добавьте три бита четности и преобразуйте их в 7 закодированных битов, используя систематический код Хэмминга (7,4)

(c) Добавить белый гауссовский шум

(d) Выполнить декодирование с жестким решением – вычислить синдром ошибки для групп из 7 битов, исправить одиночные ошибки

(e) Выполнить декодирование с мягким решением

(f) Подсчитать количество ошибок как для жесткого решения, так и для декодирования мягкого решения

(g) Повторить для нескольких значений и построить результаты моделирования.

Щелкните здесь, чтобы загрузить скрипт Matlab/Octave для вычисления BER для BPSK в коде Хэмминга (7,4) с декодированием мягких и жестких решений.

Рисунок : График BER для кода Хэмминга (7,4) с декодированием с мягким и жестким решением

Наблюдения Декодирование с мягким решением стремится к асимптотическим числам выигрыша кодирования.

Ссылки

Цифровые коммуникации Джона Проакиса

Цифровые коммуникации: Третье издание, Джон Р. Барри, Эдвард А. Ли, Дэвид Г. Мессершмитт

Теги: АВГН, БПСК, Хэмминг, мягкий

Понравилась ли вам эта статья? Убедитесь, что вы не пропустите новую статью подписавшись на RSS-канал ИЛИ подписавшись на информационный бюллетень по электронной почте. Примечание. Подписка по электронной почте дает вам право на бесплатную загрузку электронной книги по BER для BPSK/QPSK/16QAM/16PSK в AWGN.

Модели декодирования и кодирования раскрывают роль ментальной симуляции в представлении смысла мозгом

1. Дамасио А.Р.

1989.

Заблокированная во времени мультирегиональная ретроактивация: предложение системного уровня для нейронных субстратов припоминания и распознавания. Познание

33, 25–62. ( 10.1016/0010-0277(89)-X) [PubMed] [CrossRef] [Google Scholar]

Дамасио А.Р.

1989.

Заблокированная во времени мультирегиональная ретроактивация: предложение системного уровня для нейронных субстратов припоминания и распознавания. Познание

33, 25–62. ( 10.1016/0010-0277(89)-X) [PubMed] [CrossRef] [Google Scholar]

2. Барсалу Л.В. 1999. Перцептивные системы символов. Поведение наук о мозге. 22, 577–660. ( 10.1017/S0140525X9

49) [PubMed] [CrossRef] [Google Scholar]3. Паттерсон К., Нестор П.Дж., Роджерс Т.Т. 2007. Откуда ты знаешь, что ты знаешь? Представление семантических знаний в мозгу человека. Нац. Преподобный Нейроски. 8, 976–987. ( 10.1038/nrn2277) [PubMed] [CrossRef] [Google Scholar]

4. Ralph MAL, Jefferies E, Patterson K, Rogers TT. 2017. Нейронно-вычислительные основы семантического познания. Нац. Преподобный Нейроски. 18, 42 (10.1038/nrn.2016.150) [PubMed] [CrossRef] [Google Scholar]

5. Price AR, Peelle JE, Bonner MF, Grossman M, Hamilton RH.

2016.

Причинные доказательства механизма семантической интеграции в угловой извилине, выявленные с помощью транскраниальной стимуляции постоянным током высокого разрешения. Дж. Нейроски.

36, 3829–3838. (10.1523/JNEUROSCI.3120-15.2016) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

Дж. Нейроски.

36, 3829–3838. (10.1523/JNEUROSCI.3120-15.2016) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

6. Binder JR, Desai RH. 2011. Нейробиология семантической памяти. Тенденции Познан. науч. 15, 527–536. ( 10.1016/j.tics.2011.10.001) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

7. Симанова И., Хагоорт П., Остенвельд Р., ван Гервен М.А. 2012. Модально-независимая расшифровка семантической информации от человеческого мозга. Церебр. кора 24, 426–434. ( 10.1093/cercor/bhs324) [PubMed] [CrossRef] [Google Scholar]

8. Шинкарева С.В., Малаве В.Л., Мейсон Р.А., Митчелл Т.М., Джаст М.А. 2011. Общность нейронных представлений слов и изображений. НейроИзображение 54, 2418–2425. (10.1016/j.neuroimage.2010.10.042) [PubMed] [CrossRef] [Google Scholar]

9. Huth AG, de Heer WA, Griffiths TL, Theunissen FE, Gallant JL. 2016. Естественная речь раскрывает семантические карты коры головного мозга человека. Природа 532, 453–458. ( 10.1038/nature17637) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

10. Митчелл Т.М., Шинкарева С.В., Карлсон А., Чанг К-М, Малаве В.Л., Мейсон Р.А., Джаст М.А.

2008.

Прогнозирование деятельности мозга человека, связанной со значениями существительных. Наука

320, 1191–1195. ( 10.1126/science.1152876) [PubMed] [CrossRef] [Google Scholar]

Митчелл Т.М., Шинкарева С.В., Карлсон А., Чанг К-М, Малаве В.Л., Мейсон Р.А., Джаст М.А.

2008.

Прогнозирование деятельности мозга человека, связанной со значениями существительных. Наука

320, 1191–1195. ( 10.1126/science.1152876) [PubMed] [CrossRef] [Google Scholar]

11. Devereux BJ, Clarke A, Marouchos A, Tyler LK. 2013. Анализ репрезентативного сходства выявляет общие черты и различия в семантической обработке слов и объектов. Дж. Нейроски. 33, 18 906–18 916. (10.1523/JNEUROSCI.3809-13.2013) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

12. Anderson AJ, Bruni E, Lopopolo A, Poesio M, Baroni M. 2015. Чтение визуально воплощенного значения из мозга: визуально обоснованные вычислительные модели декодируют мысленные образы визуальных объектов, вызванные письменным текстом. НейроИзображение 120, 309–322. ( 10.1016/j.neuroimage.2015.06.093) [PubMed] [CrossRef] [Google Scholar]

13. Martin CB, Douglas D, Newsome RN, Man LL, Barense MD.

2018.

Интегративное и различительное кодирование визуальных и концептуальных признаков объекта в вентральном зрительном потоке. электронная жизнь. ( 10.7554/eLife.31873) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

электронная жизнь. ( 10.7554/eLife.31873) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

14. Деверо Б.Дж., Кларк А., Тайлер Л.К. 2018. Интегрированные нейронные сети глубоких визуальных и семантических аттракторов предсказывают информацию о шаблонах фМРТ вдоль вентрального пути обработки объекта. науч. Респ. 8 (10.1038/s41598-018-28865-1) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

15. Fernandino L, Humphries CJ, Conant LL, Seidenberg MS, Binder JR. 2016. Гетеромодальные области коры кодируют сенсомоторные особенности значения слова. Дж. Нейроски. 36, 9763–9769. ( 10.1523/JNEUROSCI.4095-15.2016) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

16. Anderson AJ, Binder JR, Fernandino L, Humphries CJ, Conant LL, Raizada RD, Lin F, Lalor EC. 2019. Интегрированный нейронный декодер лингвистического и эмпирического значения. Дж. Нейроски. 39, 8969–8987. ( 10.1523/JNEUROSCI.2575-18.2019) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

17. Бухвейц А., Шинкарева С.В., Мейсон Р.А., Митчелл Т.М., Джаст М.А.

2012.

Идентификация двуязычных семантических нейронных представлений на разных языках. Брейн Ланг.

120, 282–289. ( 10.1016/j.bandl.2011.09.003) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

Бухвейц А., Шинкарева С.В., Мейсон Р.А., Митчелл Т.М., Джаст М.А.

2012.

Идентификация двуязычных семантических нейронных представлений на разных языках. Брейн Ланг.

120, 282–289. ( 10.1016/j.bandl.2011.09.003) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

18. Craik FI, Lockhart RS. 1972. Уровни обработки: основа для исследования памяти. J. Вербальное обучение. Вербальное поведение. 11, 671–684. ( 10.1016/S0022-5371(72)80001-X) [CrossRef] [Google Scholar]

19. Биндер Дж. Р., Десаи Р. Х., Грейвс В. В., Конант Л. Л. 2009. Где семантическая система? Критический обзор и метаанализ 120 исследований функциональной нейровизуализации. Церебр. кора 19, 2767–2796. ( 10.1093/cercor/bhp055) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

20. Daselaar SM, Porat Y, Huijbers W, Pennartz CM. 2010. Модально-специфические и модально-независимые компоненты системы образов человека. НейроИзображение 52, 677–685. (10.1016/j.neuroimage.2010.04.239) [PubMed] [CrossRef] [Google Scholar]

21. Huijbers W, Pennartz CM, Rubin DC, Daselaar SM.

2011.

Образы и поиск слуховой и визуальной информации: нейронные корреляты успешного и неудачного выступления. Нейропсихология

49, 1730–1740 гг. ( 10.1016/j.neuropsychologia.2011.02.051) [PubMed] [CrossRef] [Google Scholar]

Huijbers W, Pennartz CM, Rubin DC, Daselaar SM.

2011.

Образы и поиск слуховой и визуальной информации: нейронные корреляты успешного и неудачного выступления. Нейропсихология

49, 1730–1740 гг. ( 10.1016/j.neuropsychologia.2011.02.051) [PubMed] [CrossRef] [Google Scholar]

22. Барсалу Л.В. 2008. Когнитивный и нейронный вклад в понимание концептуальной системы. Курс. Реж. Психол. науч. 17, 91–95. ( 10.1111/j.1467-8721.2008.00555.x) [CrossRef] [Google Scholar]

23. Пирс Дж.В. 2007. Программное обеспечение Psychopy–психофизика на Python. Дж. Нейроски. Методы 162, 8–13. ( 10.1016/j.jneumeth.2006.11.017) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

24. Душон А., Переа М., Себастьян-Гальес Н., Марти А., Каррейрас М. 2013. EsPal: универсальный магазин недвижимости на испанском языке. Поведение Рез. Методы 45, 1246–1258. ( 10.3758/s13428-013-0326-1) [PubMed] [CrossRef] [Google Scholar]

25. Колтхарт М.

1981.

Психолингвистическая база данных MRC. QJ Exp. Психол. Раздел А

33, 497–505. ( 10.1080/14640748108400805) [CrossRef] [Google Scholar]

Психол. Раздел А

33, 497–505. ( 10.1080/14640748108400805) [CrossRef] [Google Scholar]

26. Смит С. 2002. Быстрое надежное автоматизированное извлечение мозга. Гум. Карта мозга. 17, 143–155. ( 10.1002/hbm.10062) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

27. Дженкинсон М., Баннистер П., Брэди М., Смит С.М. 2002. Улучшена оптимизация для надежной и точной линейной регистрации и коррекции движения изображений мозга. Нейроизображение 17, 825–841. (10.1006/nimg.2002.1132) [PubMed] [CrossRef] [Google Scholar]

28. Pruim RH, Mennes M, van Rooij D, Llera A, Buitelaar JK, Beckmann CF. 2015. ICA-AROMA: надежная стратегия на основе ICA для удаления артефактов движения из данных фМРТ. Нейроизображение 112, 267–277. ( 10.1016/j.neuroimage.2015.02.064) [PubMed] [CrossRef] [Google Scholar]

29. Биндер Дж. Р., Десаи Р. Х., Грейвс В. В., Конант Л. Л.

2009.

Где семантическая система? Критический обзор и метаанализ 120 исследований функциональной нейровизуализации. Церебр. кора

19, 2767–2796. ( 10.1093/cercor/bhp055) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

Церебр. кора

19, 2767–2796. ( 10.1093/cercor/bhp055) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

30. Pedregosa F. и др. 2011. Scikit-learn: машинное обучение на Python. Дж. Мах. Учиться. Рез. 12, 2825–2830. [Google Scholar]

31. Hanke M, Halchenko YO, Sederberg PB, Hanson SJ, Haxby JV, Pollmann S. 2009 г.. PyMVPA: набор инструментов Python для многомерного анализа данных фМРТ. Нейроинформатика 7, 37–53. ( 10.1007/s12021-008-9041-y) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

32. Fan R, Chang K, Hsieh C, Wang X, Lin C. 2008. Liblinear: библиотека для большой линейной классификации. Дж. Мах. Учиться. Рез. 9, 1871–1874 гг. [Google Scholar]

33. Varoquaux G, Raamana PR, Engemann DA, Hoyos-Idrobo A, Schwartz Y, Thirion B. 2016. Оценка и настройка декодеров мозга: перекрестная проверка, предостережения и рекомендации. НейроИзображение 145, 166–179. ( 10.1016/j.neuroimage.2016.10.038) [PubMed] [CrossRef] [Google Scholar]

34. Перейра Ф., Митчелл Т., Ботвиник М.

2009.

Классификаторы машинного обучения и фМРТ: обзор учебного пособия. Нейроизображение

45, С199–С209. ( 10.1016/j.neuroimage.2008.11.007) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

Перейра Ф., Митчелл Т., Ботвиник М.

2009.

Классификаторы машинного обучения и фМРТ: обзор учебного пособия. Нейроизображение

45, С199–С209. ( 10.1016/j.neuroimage.2008.11.007) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

35. Митчелл Т., Хатчинсон Р., Никулеску Р., Перейра Ф., Ван Х., М.А. Дж., Ньюман С. . 2004. Обучение декодированию когнитивных состояний по изображениям мозга. Мах. Учиться. 13, 667–668. ( 10.1023/b:мач.0000035475.85309.1b) [CrossRef] [Google Scholar]

36. Mourão Miranda J, Bokde ALW, Born C, Hampel H, Stetter M. 2005. Классификация состояний мозга и определение различающих паттернов активации: машина опорных векторов по данным функциональной МРТ. НейроИзображение 28, 980–995. (10.1016/j.neuroimage.2005.06.070) [PubMed] [CrossRef] [Google Scholar]

37. Coutanche MN, Thompson-Schill SL.

2013.

Информационная связь: выявление синхронизированной различимости многовоксельных паттернов в мозгу. Фронт. Гум. Неврологи.

7, 15 ( 10,3389/fnhum. 2013.00015) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

2013.00015) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

38. Bravo-Marquez F, Kubelka J. 2018. вложения испанских слов. См. https://tinyurl.com/y47xzh6l.

39. Симонян К., Зиссерман А. 2014 Очень глубокие сверточные сети для крупномасштабного распознавания изображений. (http://arxiv.org/abs/1409.1556.)

40. Ховард А.Г., Чжу М., Чен Б., Калениченко Д., Ван В., Вейанд Т., Андреетто М., Адам Х. 2017 Mobilenets: эффективные сверточные нейронные сети для приложений мобильного зрения. (http://arxiv.org/abs/arXiv:1704.04861.)

41. Хуанг Г., Лю З., Ван Дер Маатен Л., Вайнбергер К.К. 2017. Плотносвязные сверточные сети. В проц. конференции IEEE. по компьютерному зрению и распознаванию образов, Гонолулу, Гавайи, 21–26 июля , стр. 4700–4708 (doi:10.1109/CVPR. 2017.243)

42. Шолле Ф. 2015. керас. См. https://tinyurl.com/pna7m6p.

43. Менил Г. и др. 2011.

Неконтролируемое и переносное обучение: подход к глубокому обучению. В проц. 2011 междунар. конф. на семинаре по неконтролируемому обучению и передаче знаний, Белвью, Вашингтон, , том. 27, стр. 97–111.

В проц. 2011 междунар. конф. на семинаре по неконтролируемому обучению и передаче знаний, Белвью, Вашингтон, , том. 27, стр. 97–111.

44. Йосински Дж., Клун Дж., Бенжио Ю., Липсон Х. 2014. Насколько переносимы функции в глубоких нейронных сетях? В Advances in Neural Information Processing Systems, Монреаль, Канада, 8–13 декабря , стр. 3320–3328.

45. Фей-Фей Л., Фергус Р., Перона П. 2004. Изучение генеративных визуальных моделей на нескольких обучающих примерах: пошаговый байесовский подход протестирован на 101 категории объектов. В конф. на семинаре по компьютерному зрению и распознаванию образов, Вашингтон, округ Колумбия, 27 июня – 2 июля , стр. 178–178. IEEE.

46. Кламбауэр Г., Унтертинер Т., Майр А., Хохрайтер С. 2017 Самонормирующиеся нейронные сети. В Достижения в системах обработки нейронной информации 30 (NIPS 2017) . (arXiv:1706.02515)

47. Лекун Ю.А., Ботту Л., Орр Г.Б., Мюллер К.Р.

2012.

Эффективный бэкпроп. В Нейронные сети: торговые хитрости (редакторы Г. Монтавон, Г. Б. Орр, К. Р. Мюллер), стр. 9–48. Берлин, Германия: Springer.

В Нейронные сети: торговые хитрости (редакторы Г. Монтавон, Г. Б. Орр, К. Р. Мюллер), стр. 9–48. Берлин, Германия: Springer.

48. Кингма Д.П., Ба Дж. 2014 Адам: метод стохастической оптимизации. В Междунар. конф. для учебных представительств, Сан-Диего . (arXiv:1412.6980v9)

49. Фриман Дж., Зиемба К.М., Хигер Д.Дж., Симончелли Э.П., Мовшон Дж.А. 2013. Функциональная и перцептивная характеристика второй зрительной области у приматов. Нац. Неврологи. 16, 974 ( 10.1038/nn.3402) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

50. Majaj NJ, Hong H, Solomon EA, DiCarlo JJ. 2015. Простые выученные взвешенные суммы частоты возбуждения нижних височных нейронов точно предсказывают эффективность распознавания основных объектов человека. Дж. Нейроски. 35, 13 402–13 418. (10.1523/JNEUROSCI.5181-14.2015) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

51. Рен С., Хе К., Гиршик Р., Сан Дж.

2015 Faster R-CNN: на пути к обнаружению объектов в реальном времени с сетями региональных предложений. В Advances in Neural Information Processing Systems, Монреаль, Канада, 7–12 декабря , стр. 91–99. (arXiv:1506.01497v3)

В Advances in Neural Information Processing Systems, Монреаль, Канада, 7–12 декабря , стр. 91–99. (arXiv:1506.01497v3)

52. He K, Zhang X, Ren S, Sun J. 2016. Глубокое остаточное обучение для распознавания изображений. В проц. конференции IEEE. по компьютерному зрению и распознаванию образов , стр. 770–778. IEEE. (10.1109/CVPR.2016.90) [Перекрестная ссылка]

53. Русаковский О. и др. 2015. Крупномасштабная задача визуального распознавания Imagenet. Междунар. Дж. Вычисл. Зрение 115, 211–252. ( 10.1007/s11263-015-0816-y) [CrossRef] [Google Scholar]

54. Miyawaki Y, Uchida H, Yamashita O, Sato MA, Morito Y, Tanabe HC, Sadato N, Kamitani Y. 2008. Реконструкция визуального изображения активности человеческого мозга с использованием комбинации многомасштабных локальных декодеров изображений. Нейрон 60, 915–929. ( 10.1016/j.neuron.2008.11.004) [PubMed] [CrossRef] [Google Scholar]

55. Buitinck L. et al. 2013 Разработка API для программного обеспечения для машинного обучения: опыт проекта scikit-learn. In ECML PKDD Workshop: Languages for Data Mining and Machine Learning, Прага, Чехия, 23 сентября , стр. 108–122. (arXiv:1309.0238)

In ECML PKDD Workshop: Languages for Data Mining and Machine Learning, Прага, Чехия, 23 сентября , стр. 108–122. (arXiv:1309.0238)

56. Holdgraf CR, Rieger JW, Micheli C, Martin S, Knight RT, Theunissen FE. 2017. Модели кодирования и декодирования в когнитивной электрофизиологии. Фронт. Сист. Неврологи. 11, 61 ( 10.3389/fnsys.2017.00061) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

57. Varoquaux G, Raamana PR, Engemann DA, Hoyos-Idrobo A, Schwartz Y, Thirion B. 2017. Оценка и настройка декодеров мозга: перекрестная проверка, предостережения и рекомендации. НейроИзображение 145, 166–179. ( 10.1016/j.neuroimage.2016.10.038) [PubMed] [CrossRef] [Google Scholar]

58. Diedrichsen J, Kriegeskorte N. 2017. Репрезентативные модели: общая структура для понимания анализа кодирования, компонентов шаблона и репрезентативного подобия. PLoS-компьютер. биол. 13, e1005508 ( 10.1371/journal.pcbi.1005508) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

59. Кригескорте Н., Дуглас П.К.

2018.

Когнитивная вычислительная нейробиология. Нац. Неврологи.

21, 1148–1160. ( 10.1038/s41593-018-0210-5) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

Кригескорте Н., Дуглас П.К.

2018.

Когнитивная вычислительная нейробиология. Нац. Неврологи.

21, 1148–1160. ( 10.1038/s41593-018-0210-5) [бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

60. Миколов Т., Суцкевер И., Чен К., Коррадо Г.С., Дин Дж. 2013. Распределенные представления слов и фраз и их композиционность. В Advances in Neural Information Processing Systems, Lake Tahoe, CA, 5–10 декабря , стр. 3111–3119.

61. ЛеКун Ю., Ботту Л., Бенжио Ю., Хаффнер П. 1998. Градиентное обучение применительно к распознаванию документов. проц. IEEE 86, 2278–2324. ( 10.1109/5.726791) [CrossRef] [Google Scholar]

62. Шейх Ю.А., Каррейрас М., Сото Д. 2019. Нейрокогнитивные механизмы, поддерживающие обобщение понятий между языками (10.31234/osf.io/7g6dk) [CrossRef]

63. Вагнер А.Д., Паре-Благоев Э.Дж., Кларк Дж., Полдрак Р.А.

2001.

Восстановление смысла: левая префронтальная кора направляет контролируемое семантическое извлечение. Нейрон

31, 329–338. ( 10.1016/S0896-6273(01)00359-2) [PubMed] [CrossRef] [Google Scholar]

( 10.1016/S0896-6273(01)00359-2) [PubMed] [CrossRef] [Google Scholar]

64. Полдрак Р.А., Вагнер А.Д., Прулл М.В., Десмонд Дж.Е., Гловер Г.Х., Габриэли Д.Д. 1999. Функциональная специализация семантической и фонологической обработки в левой нижней префронтальной коре. Нейроизображение 10, 15–35. ( 10.1006/nimg.1999.0441) [PubMed] [CrossRef] [Google Scholar]

65. Whitney C, Kirk M, O’Sullivan J, Lambon Ralph MA, Jefferies E. 2010. Нейронная организация семантического контроля: данные ТМС о распределенной сети в левой нижней лобной и задней средней височной извилинах. Церебр. кора 21, 1066–1075. ( 10.1093/cercor/bhq180) [Бесплатная статья PMC] [PubMed] [CrossRef] [Google Scholar]

66. Anzellotti S, Coutanche MN. 2018. Помимо функциональной связности: исследование сетей многомерных представлений. Тенденции Познан. науч. 22, 258–269. ( 10.1016/j.tics.2017.12.002) [PubMed] [CrossRef] [Google Scholar]

67. Нунан К.А., Джеффрис Э., Виссер М., Ламбон Ральф М.А.

2013. Выход за рамки нижнего префронтального участия в семантическом контроле: свидетельство дополнительного вклада дорсальной угловой извилины и задней средней височной коры. Дж. Когн. Неврологи.

25, 1824–1850 гг. ( 10.1162/jocn_a_00442) [PubMed] [CrossRef] [Google Scholar]

Выход за рамки нижнего префронтального участия в семантическом контроле: свидетельство дополнительного вклада дорсальной угловой извилины и задней средней височной коры. Дж. Когн. Неврологи.

25, 1824–1850 гг. ( 10.1162/jocn_a_00442) [PubMed] [CrossRef] [Google Scholar]

68. Печер Д., ван Данциг С., Шифферштейн Х.Н.Дж. 2009. Понятия не репрезентируются сознательными образами. Психон. Бык. преп. 16, 914–919. ( 10.3758/PBR.16.5.914) [PubMed] [CrossRef] [Google Scholar]

69. Soto D, Humphreys GW. 2007. Автоматическое управление зрительным вниманием за счет вербальной рабочей памяти. Дж. Эксп. Психология: Гум. Восприятие. Выполнять. 33, 730–737. ( 10.1037/0096-1523.33.3.730) [PubMed] [CrossRef] [Google Scholar]

70. Цваан Р.А., Стэнфилд Р.А., Яксли Р.Х. 2002. Люди, понимающие язык, мысленно представляют формы объектов. Психол. науч. 13, 168–171. ( 10.1111/1467-9280.00430) [PubMed] [CrossRef] [Google Scholar]

71. Stanfield RA, Zwaan RA.

2001.

Влияние подразумеваемой ориентации, полученной из вербального контекста, на распознавание изображений.

Лента холоднокатаная – ГОСТ 2283–79. Прокат сортовой – ГОСТ 5210–95. Лента стальная плющеная – ГОСТ 10234–77.

Лента холоднокатаная – ГОСТ 2283–79. Прокат сортовой – ГОСТ 5210–95. Лента стальная плющеная – ГОСТ 10234–77.

2

2

1620

1620 и последующей термообработке

и последующей термообработке